Inteligencia Artificial (IA)

La Inteligencia Artificial (IA) ha pasado de ser un concepto de ciencia ficción a una herramienta indispensable en nuestra vida diaria y profesional. Aunque herramientas como ChatGPT han acaparado los titulares recientemente, el campo de la IA es mucho más vasto y complejo.

1. ¿Qué es la Inteligencia Artificial (IA)?

La Inteligencia Artificial (IA) es el campo de la informática que utiliza computadoras para simular la inteligencia humana. El objetivo es permitir que las máquinas exhiban comportamientos típicamente asociados con los humanos, tales como:

- Reconocimiento de patrones.

- Aprendizaje.

- Toma de decisiones.

- Resolución de problemas.

Ejemplos cotidianos de IA

Es probable que interactúes con la IA a diario sin darte cuenta. Algunos ejemplos comunes incluyen:

- Asistentes Virtuales: Siri, Alexa y Google Assistant utilizan procesamiento de lenguaje natural para entender tus comandos.

- Sistemas de Recomendación: Los algoritmos de Netflix, YouTube y Amazon analizan tu historial para sugerirte qué ver o comprar a continuación.

- Vehículos Autónomos y Robótica: El sistema FSD (Full Self-Driving) de Tesla o los coches de Waymo.

- Chatbots: Desde ChatGPT hasta los conserjes virtuales en sitios web de soporte.

- Juegos y Análisis: Motores de ajedrez como Stockfish o AlphaGo (que domina el juego Go).

El auge actual de la IA está impulsado por tres factores principales: el aumento masivo de la potencia de computación, la disponibilidad de Big Data y los avances en la investigación de algoritmos.

2. ¿Qué es el Machine Learning (ML)?

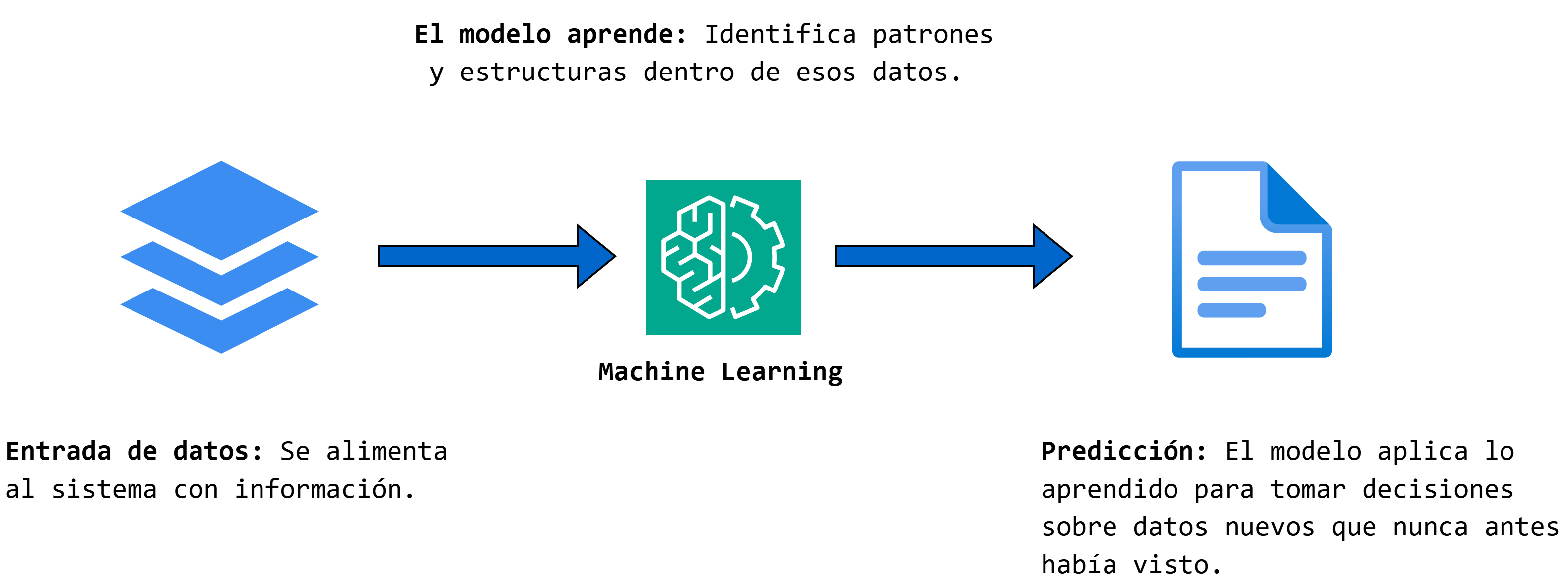

El Machine Learning (Aprendizaje Automático) es un subconjunto de la IA. Se centra en permitir que las computadoras aprendan de los datos y mejoren su rendimiento sin necesidad de programación explícita para cada tarea.

Programación Tradicional vs. ML

- Tradicional: Un humano escribe instrucciones codificadas (“Si pasa X, haz Y”).

- Machine Learning: Los algoritmos identifican patrones en los datos y toman decisiones basadas en esos patrones.

El flujo de trabajo básico del ML es:

Aplicaciones comunes: Filtrado de spam en correos, detección de fraudes bancarios y procesamiento de lenguaje natural (NLP).

Tipos de Machine Learning

No todas las máquinas aprenden de la misma manera. Existen cuatro paradigmas principales:

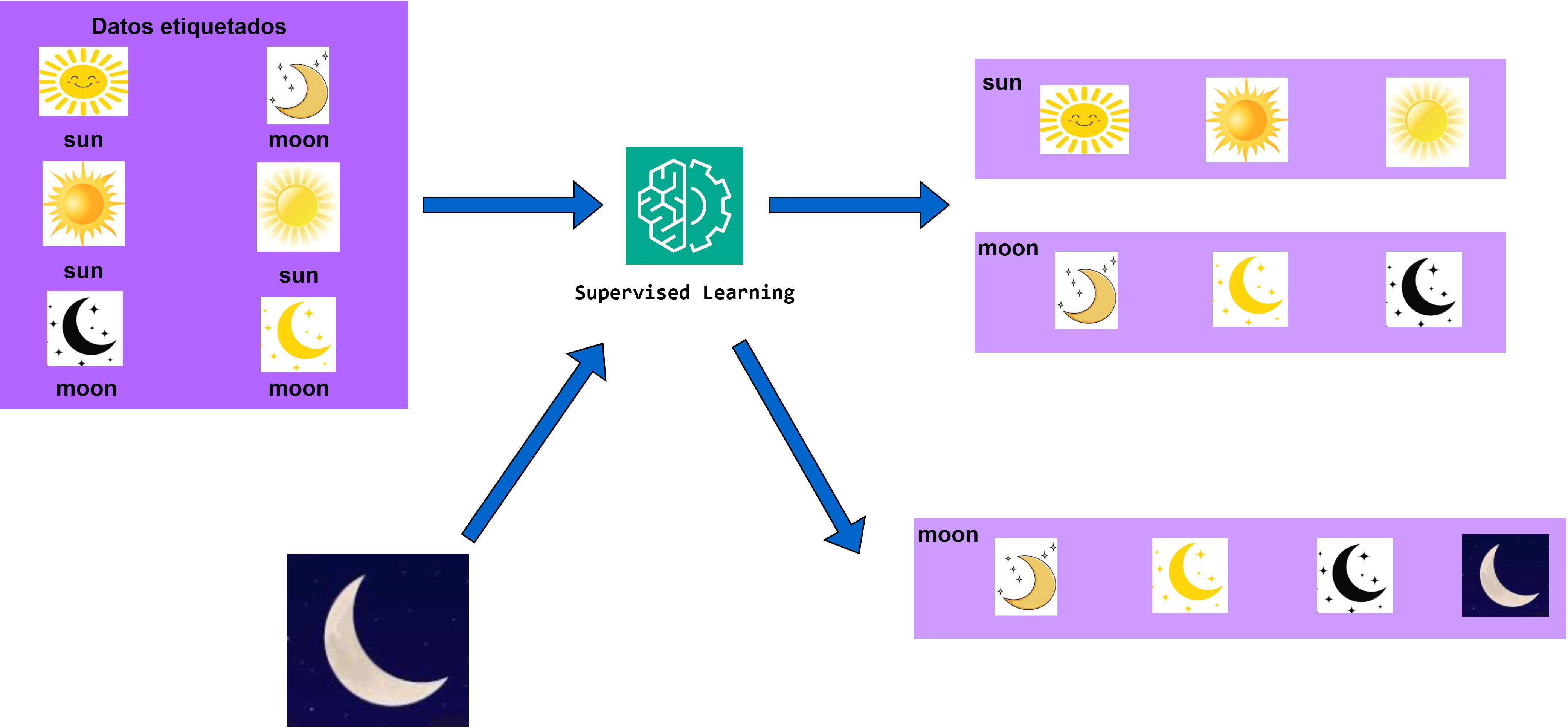

A. Aprendizaje Supervisado (Supervised Learning)

En este método, el modelo se entrena con un dataset etiquetado. Es decir, se le proporcionan las preguntas y también las respuestas correctas para que aprenda la relación entre ambas.

- Cómo funciona: Si queremos enseñar a una máquina a distinguir datos “tipo-1” y “tipo-2”, le mostramos miles de datos con ambas etiquetas.

- Objetivo: Clasificar nuevos datos con alta precisión basándose en lo aprendido.

- Ventajas: Es altamente preciso y fácil de entender.

- Desventajas: Requiere grandes cantidades de datos etiquetados manualmente, lo cual es costoso y lento. Su salida está limitada a las etiquetas que conoce.

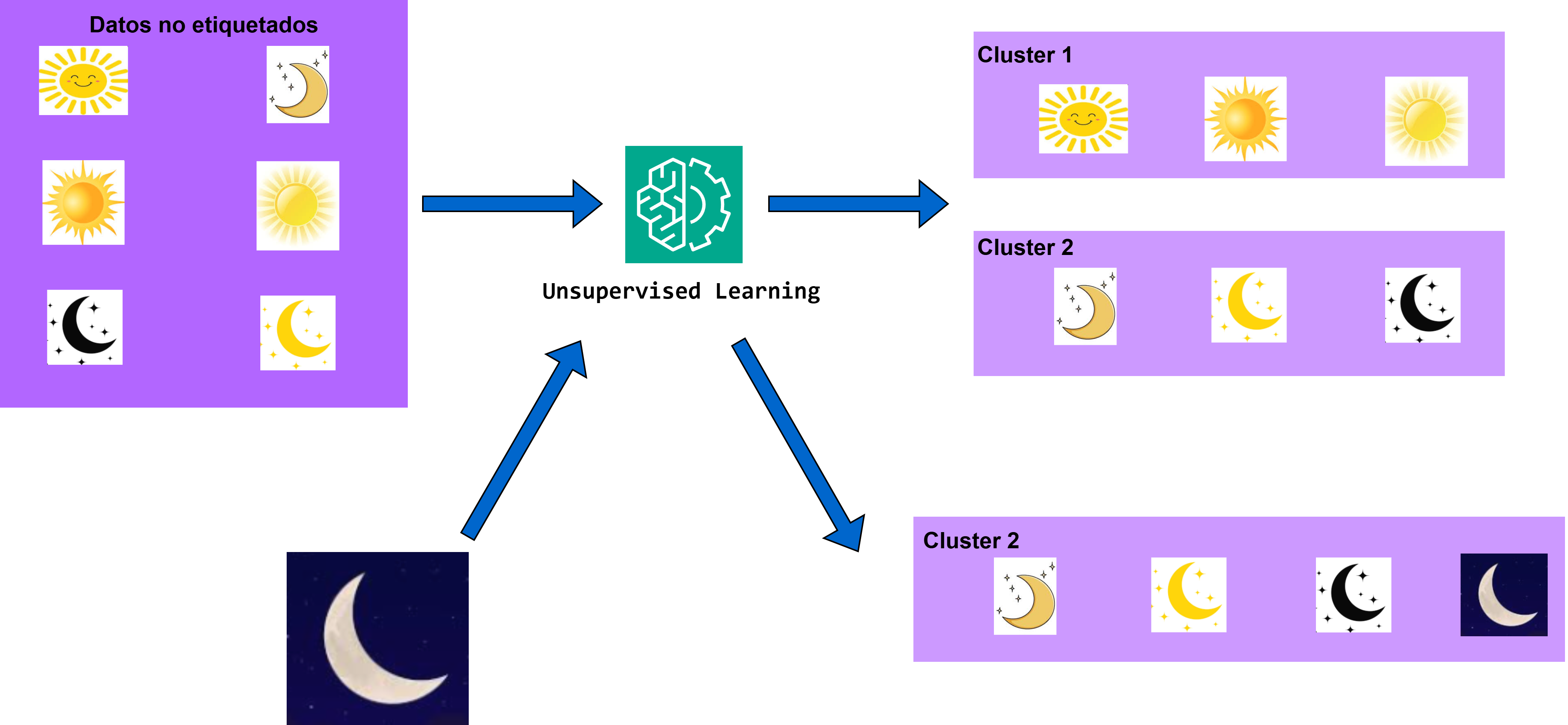

B. Aprendizaje No Supervisado (Unsupervised Learning)

Aquí, el modelo recibe datos no etiquetados. No se le dice qué es cada cosa; su tarea es encontrar patrones, estructuras o agrupaciones por sí mismo.

- Cómo funciona: Se le entregan imágenes de datos mezclados sin etiquetas. El algoritmo agrupa (hace clusters) las imágenes basándose en características visuales similares (colores, formas, angulos).

- Ventajas: No necesita intervención humana para etiquetar datos y es capaz de revelar patrones ocultos que los humanos podrían pasar por alto.

- Desventajas: Los resultados requieren interpretación humana posterior y suelen ser menos precisos que el aprendizaje supervisado.

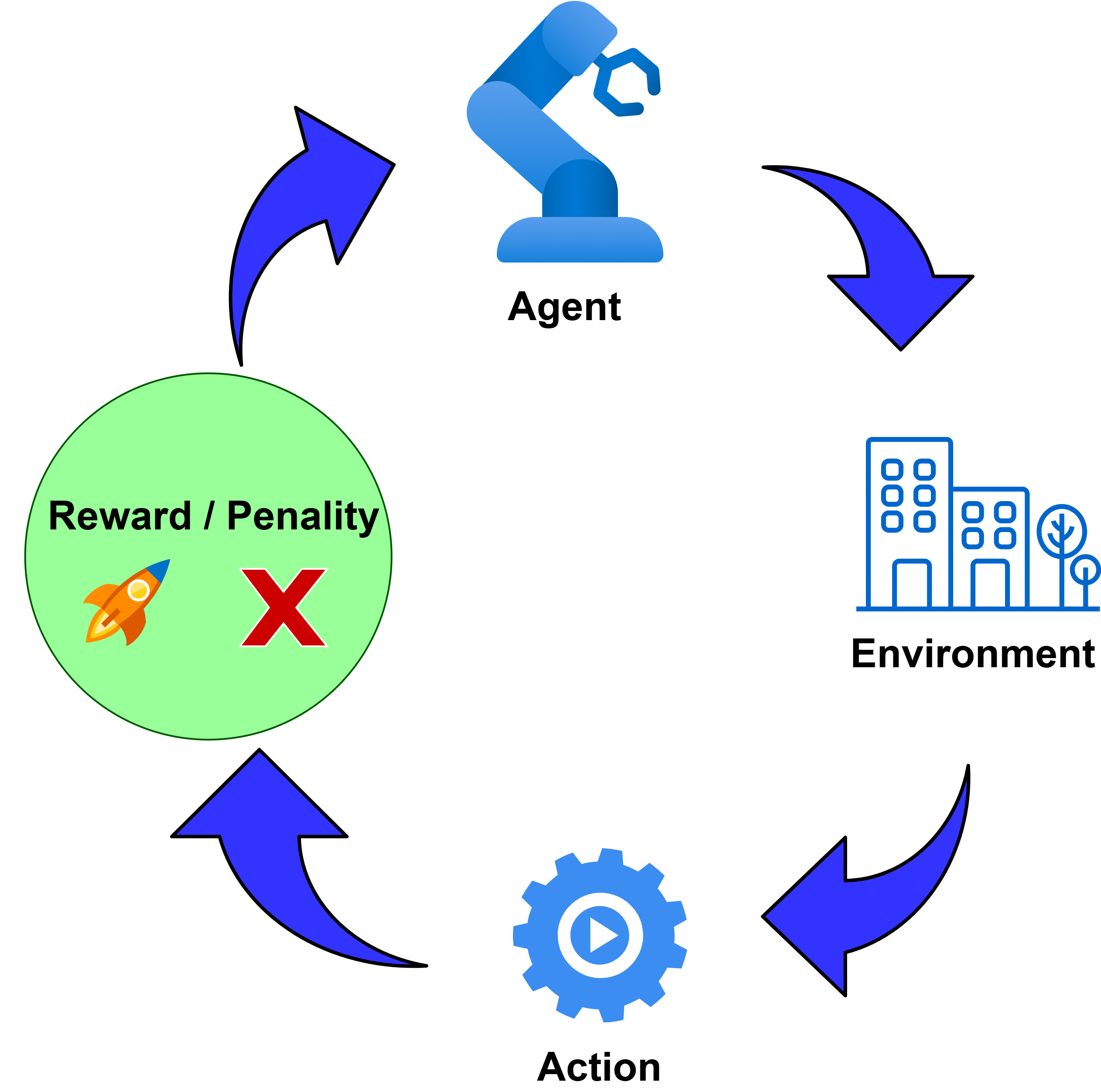

C. Aprendizaje por Refuerzo (Reinforcement Learning)

Este tipo de aprendizaje se basa en la interacción con un entorno mediante un sistema de recompensas y castigos.

- Cómo funciona: Un “agente” realiza una acción. Si la acción acerca al objetivo (ej. ganar un punto en un videojuego), recibe una recompensa (+). Si falla, recibe una penalización (-). Con el tiempo, aprende a maximizar la recompensa.

- Aplicaciones: Es fundamental en robótica (aprender a caminar), conducción autónoma y juegos complejos.

- Ventajas: Capaz de aprender comportamientos muy complejos y adaptarse a entornos dinámicos.

- Desventajas: Es intensivo en recursos y existe el riesgo de un aprendizaje subóptimo si el sistema de recompensas no está bien diseñado.

D. Deep Learning (Aprendizaje Profundo)

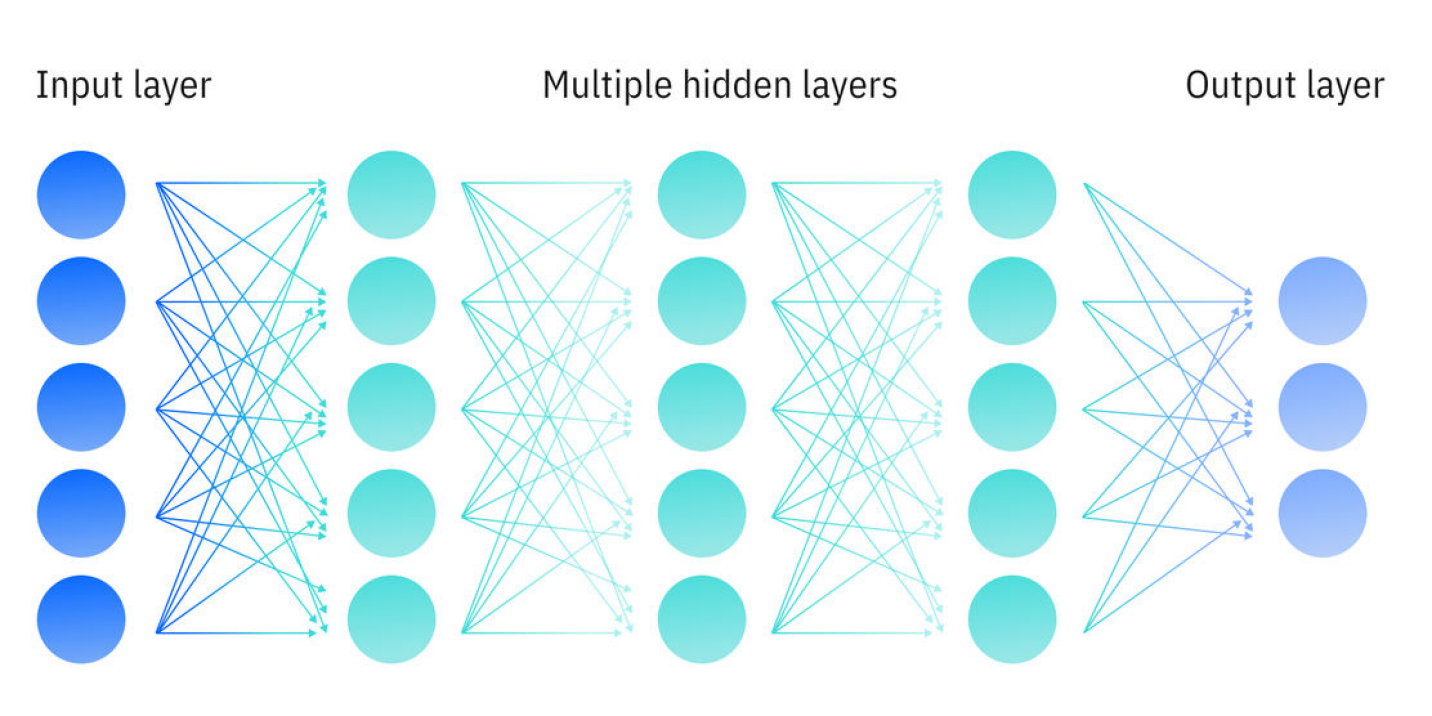

El Deep Learning es un subconjunto especializado del Machine Learning que utiliza Redes Neuronales Artificiales multicapa.

- Inspiración Biológica: Estas redes están inspiradas en cómo funciona el cerebro humano. Consisten en capas de nodos (neuronas) interconectados.

- Capas: La información pasa por una capa de entrada, atraviesa múltiples “capas ocultas” donde se extraen características cada vez más abstractas, y llega a una capa de salida.

- Poder: Es excelente para manejar datos no estructurados y complejos como imágenes, audio y texto masivo.

Pros y Contras: Logra un rendimiento de vanguardia (state-of-the-art) en reconocimiento de imagen y NLP, pero requiere un poder de cómputo inmenso y a menudo funciona como una “caja negra” (es difícil interpretar cómo llegó a una conclusión).

3. La Era Moderna: IA Predictiva vs. Generativa

Dentro del Deep Learning y el ML moderno, distinguimos dos capacidades clave:

IA Predictiva

Utiliza ML para analizar datos históricos y predecir resultados futuros o tendencias.

- Cómo funciona: Identifica correlaciones en el pasado para anticipar el futuro.

- Usos: Pronóstico del clima, detección de anomalías en seguridad, predicción de tráfico, pronósticos de ventas y diagnósticos médicos (progresión de enfermedades).

- Clave: Su éxito depende de la calidad de los datos históricos.

IA Generativa (GenAI)

Utiliza ML para aprender patrones de datos existentes y crear contenido completamente nuevo (texto, imágenes, audio, código).

- Cómo funciona: Se entrena para producir salidas que se asemejen a los datos de entrada. Por ejemplo, si le das el prompt “Genera una imagen de un gato”, crea una imagen nueva píxel por píxel basada en lo que sabe que es un gato.

- Herramientas: ChatGPT, Gemini, Midjourney, DALL-E, Sora.

- Pros: Automatización creativa masiva.

- Contras: Riesgo de “alucinaciones” (inventar datos), problemas de derechos de autor y deepfakes.

4. Aplicación Práctica: IA en Redes y Cisco

La teoría es fascinante, pero ¿cómo se aplica esto a la ingeniería de redes? La combinación de IA Predictiva y Generativa está transformando la gestión de infraestructuras IT.

IA Predictiva en Redes

Se utiliza para mantener la red estable y segura antes de que ocurran los problemas.

- Previsión de tráfico: Optimiza el ancho de banda prediciendo picos de uso.

- Detección de amenazas: Identifica anomalías en tiempo real que indican un ciberataque.

- Mantenimiento predictivo: Anticipa fallos de hardware analizando el rendimiento histórico, reduciendo el tiempo de inactividad.

IA Generativa en Redes

Actúa como un copiloto para el ingeniero de redes.

- Documentación: Genera informes automáticos sobre configuraciones y políticas.

- Generación de configuraciones: Crea configs para nuevos dispositivos basadas en políticas deseadas.

- Scripting: Escribe scripts de automatización (ej. Python) para tareas repetitivas.

- Troubleshooting: Sugiere soluciones basadas en el análisis de logs de error.

Ejemplo Real: Cisco Catalyst Center (anteriormente DNA Center)

Cisco utiliza estas tecnologías para automatizar y asegurar las redes empresariales:

- AI Network Analytics: Establece una “línea base” del comportamiento normal de la red y monitorea continuamente para detectar desviaciones.

- Machine Reasoning Engine (MRE): Utiliza IA para realizar análisis de causa raíz automatizados. No solo te dice que algo falla, sino por qué y cómo arreglarlo.

- AI Endpoint Analytics: Identifica y clasifica dispositivos desconocidos en la red para mejorar la seguridad y segmentación.

- RRM Mejorado por IA: Optimiza el rendimiento inalámbrico ajustando dinámicamente las radios de los Access Points para equilibrar la carga y reducir interferencias.

🧐 La Inteligencia Artificial no es una herramienta única, sino un ecosistema de tecnologías que van desde simples regresiones estadísticas hasta complejas redes neuronales generativas. Comprender las diferencias entre aprendizaje supervisado, no supervisado y por refuerzo, así como la distinción entre capacidades predictivas y generativas, es fundamental para cualquier profesional de TI que desee navegar el futuro de la tecnología.